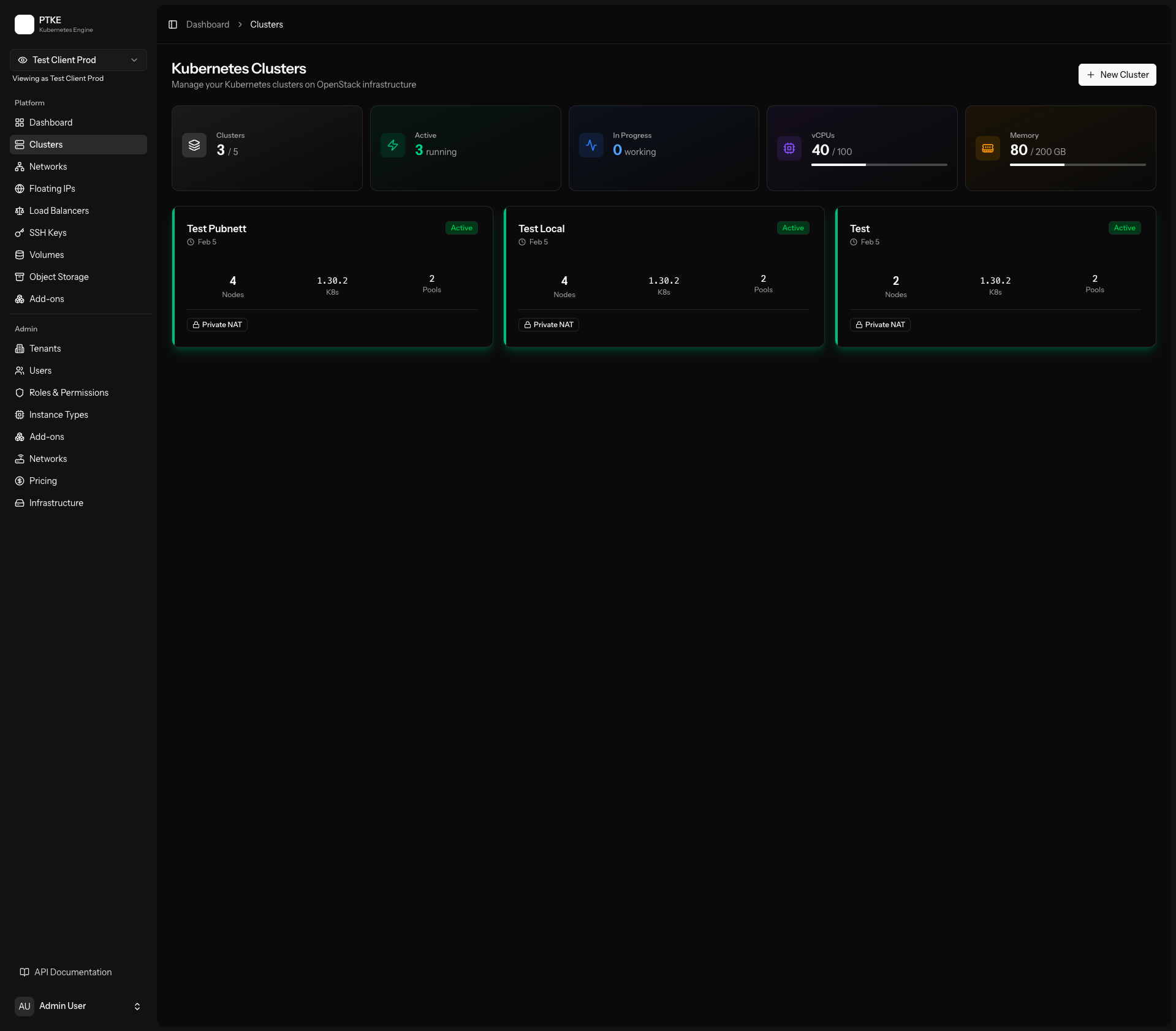

Public Clouds liefern „Managed Kubernetes" hinter einem einzigen Knopf. Prime Telecom brauchte dieselbe Erfahrung, aber auf der eigenen OpenStack-Infrastruktur — wo Souveränität, Datenresidenz und lokale Netzwerkökonomie wichtiger sind als jedes marginale Feature auf AWS oder GCP.

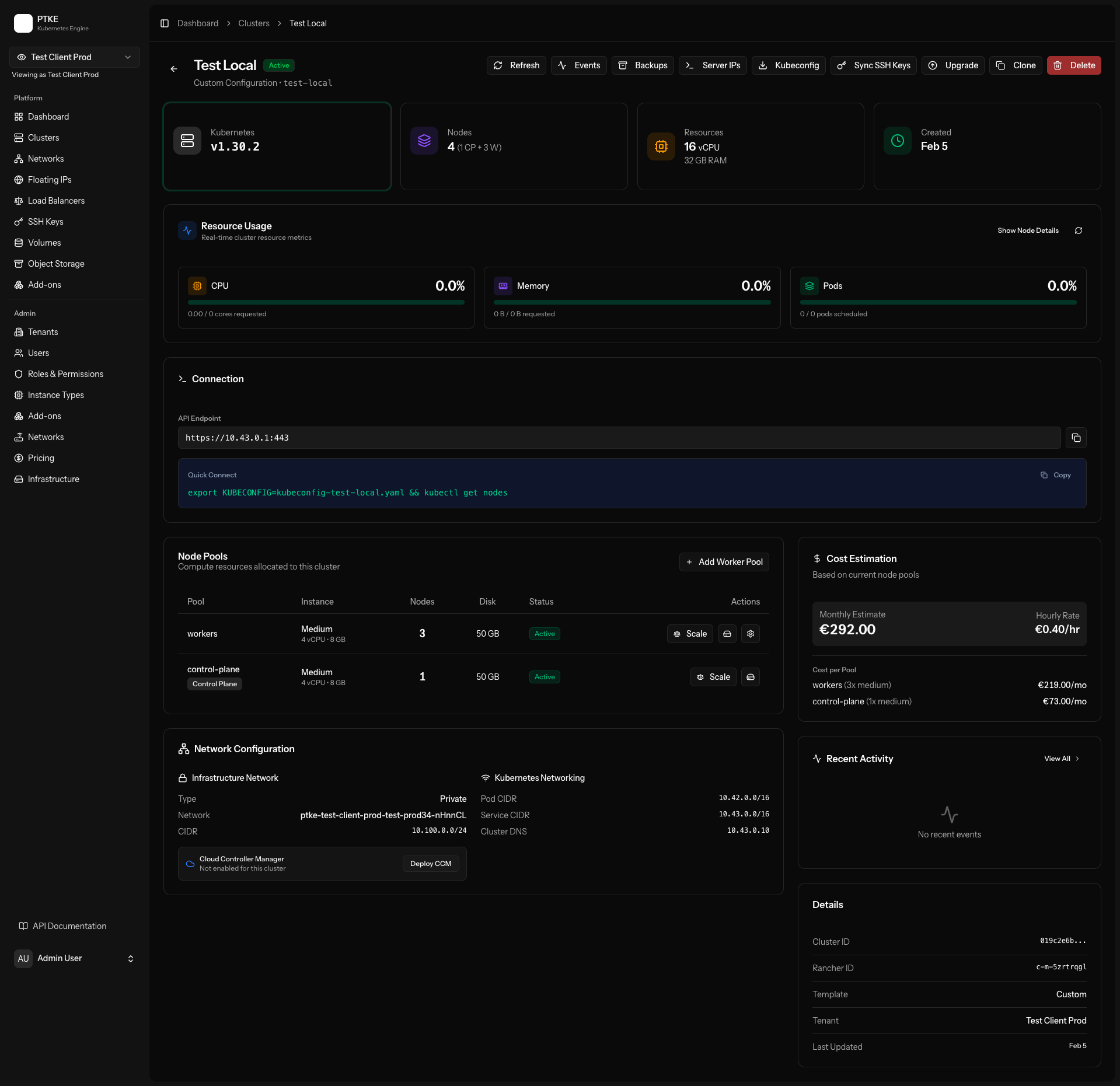

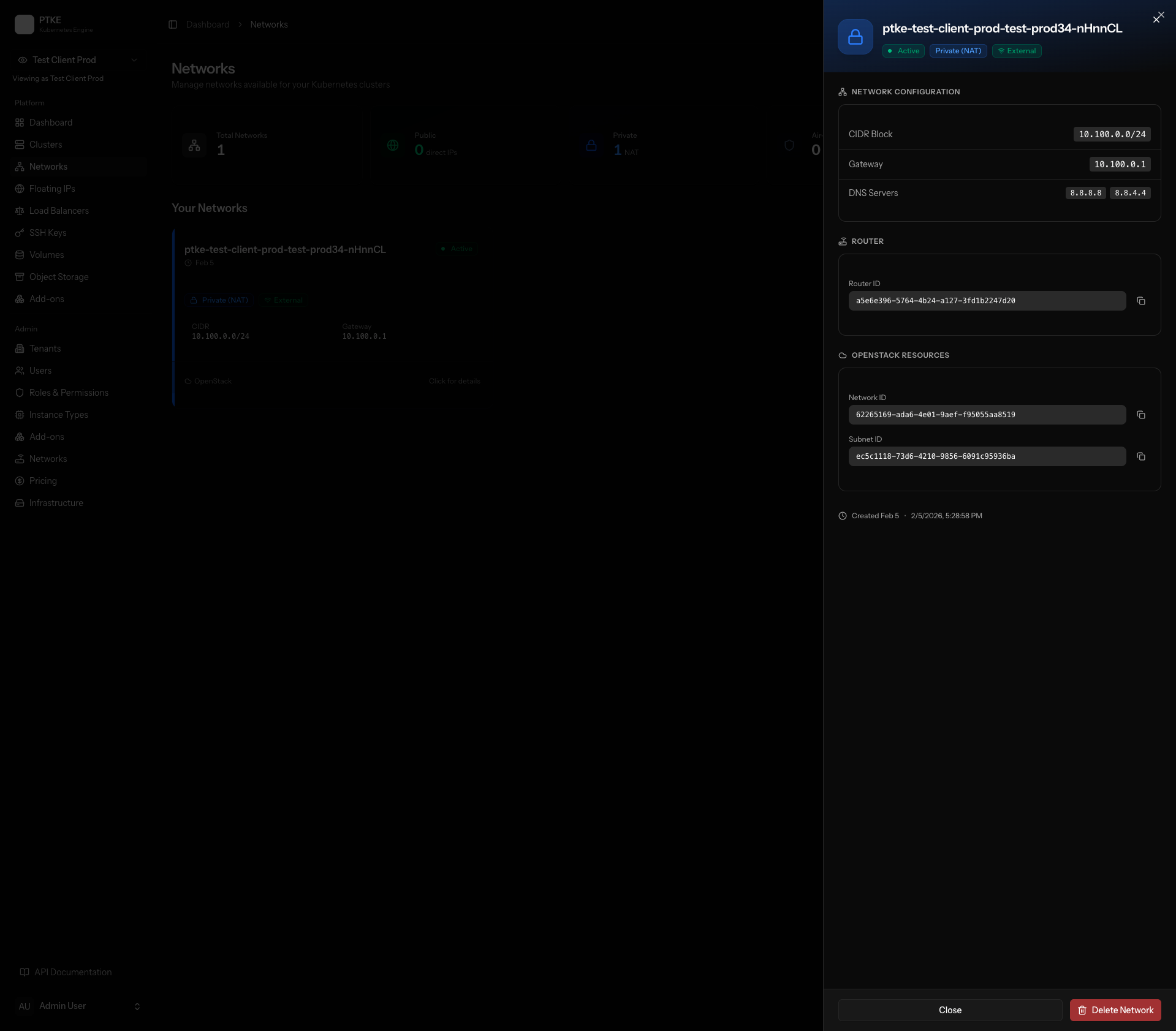

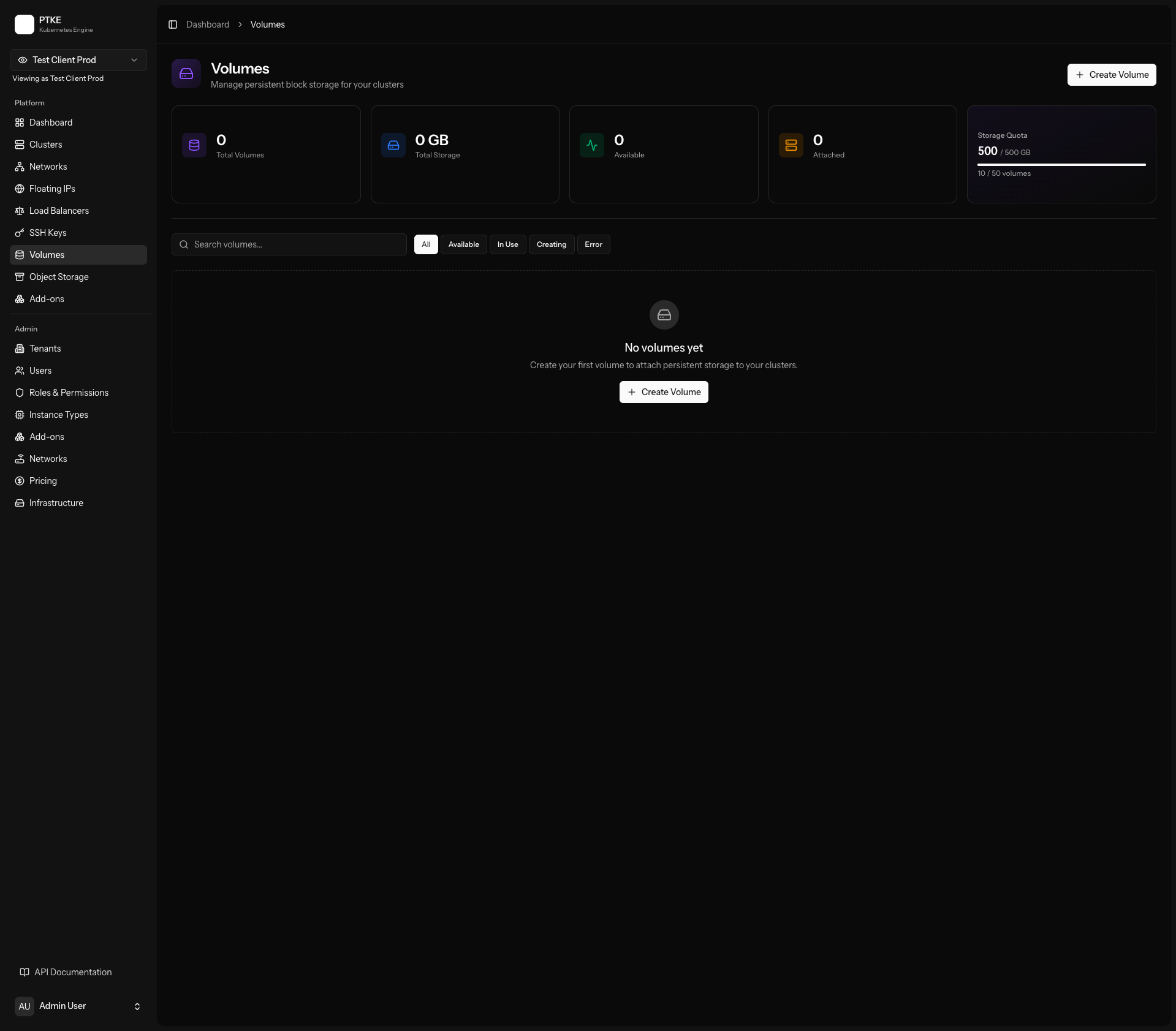

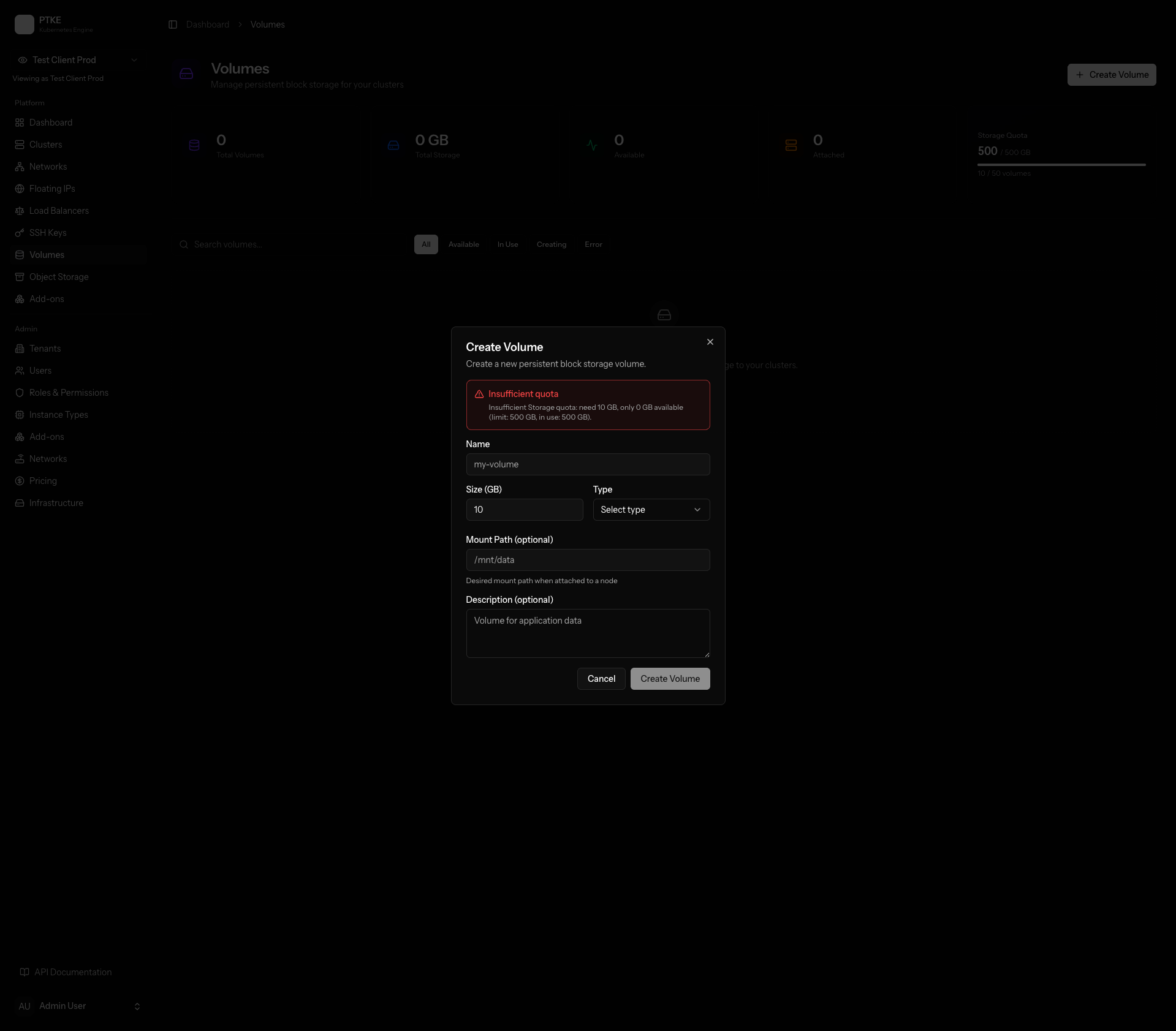

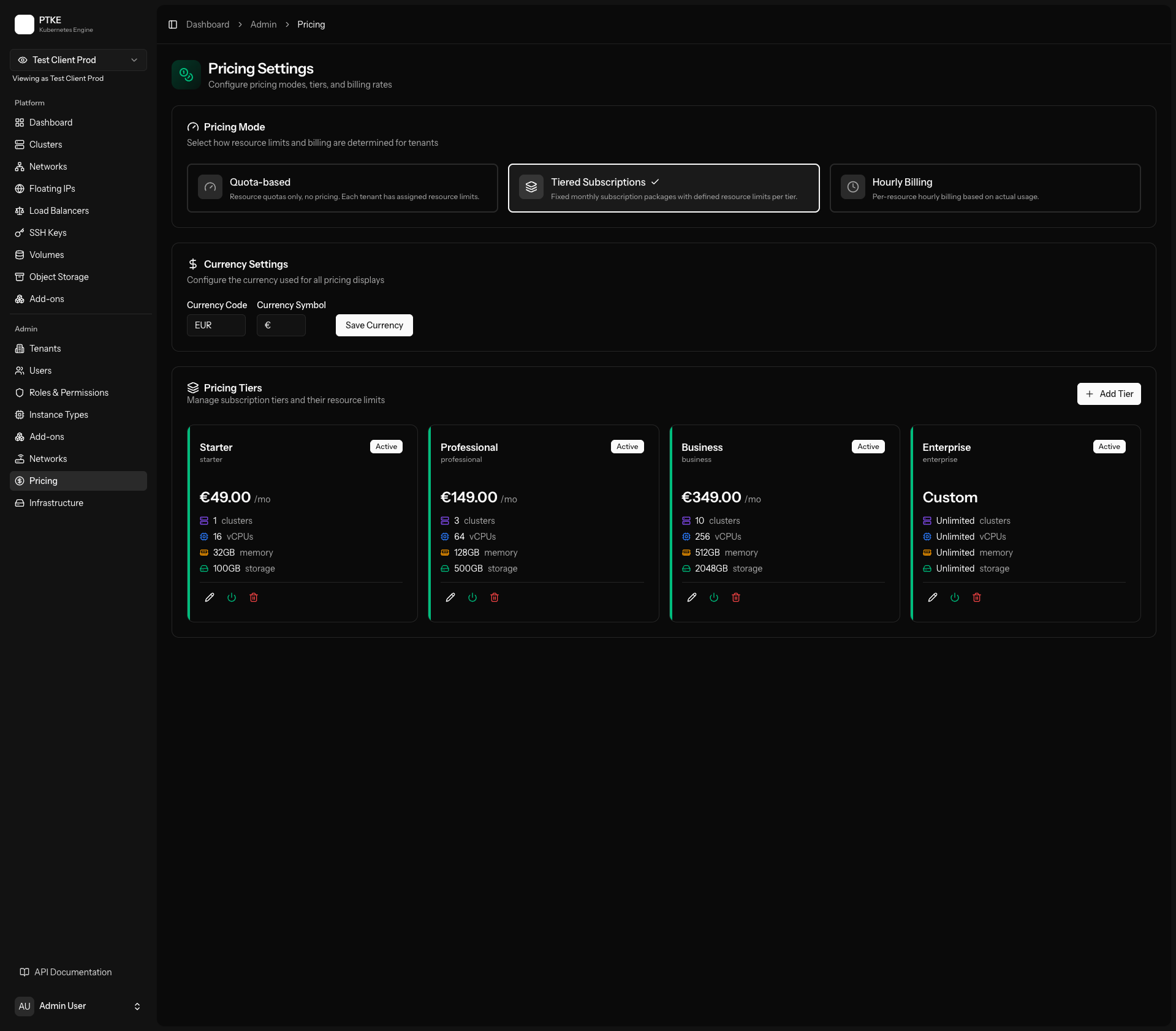

PTKE ist die Steuerungsebene, die das möglich macht: eine Laravel + Vue Anwendung, die Mandanten ermöglicht, produktionsreife Kubernetes-Cluster auf Rancher-verwaltetem RKE2, OpenStack-Compute/Networking/Storage und Velero-gestütztem Disaster Recovery zu bereitstellen, zu skalieren, zu aktualisieren, zu sichern und zu betreiben. Jede Plattform-Operation, die früher in einer Ticket-Warteschlange lebte — Cluster, Node Pools, Floating IPs, Block Volumes, Object Storage, Add-ons, Backups — ist jetzt eine Self-Service-Aktion über eine REST-API und eine Vue-3-UI.